Co je rodinný podvod AI Voice Clone? Jak to zjistit

Zásadní body

- Podvody s hlasovým klonováním využívají umělou inteligenci k napodobení hlasů s cílem manipulovat s emocemi a vyvolat pocit naléhavosti.

- Podvodníci sbírají informace ze sociálních sítí k vytvoření přesvědčivých příběhů a apelují na osobní vztahy.

- Je důležité být obezřetný a znát varovné signály hlasových klonovacích podvodů. V případě podezření je nejlepší hovor ukončit a ověřit tísňové zprávy.

Je pozdní noc a vašim rodičům přijde hlasová zpráva, ve které s panikou v hlase tvrdíte, že jste se dostali do potíží, byli jste okradeni a jste někde uvězněni. Okamžitě potřebujete poslat peníze, abyste se mohli dostat domů.

Hlas ve zprávě zní velmi autenticky a je to nepochybně hlas jejich dítěte – ale ve skutečnosti tomu tak není. Jedná se o hlasový klon vytvořený umělou inteligencí, a stali se tak obětí podvodu, který je stejně sofistikovaný jako děsivě účinný.

Jak funguje podvod s hlasovým klonováním pomocí AI?

Technologie klonování hlasu umožňuje vytvořit neuvěřitelně realistické digitální kopie lidského hlasu. Tato metoda, často nazývaná audio deepfake, se provádí za pomoci nástrojů pro klonování hlasu s využitím umělé inteligence, například ElevenLabs (příklad hlasového klonu vytvořeného AI naleznete níže). Díky kombinaci generativní AI a hlasové syntézy je klonovaný hlas schopen napodobit emoce, nuance, intonaci, a dokonce i strach.

Pro informaci, zde je ukázka, jak zní Christian Cawley, když mluví v The Really Useful Podcast.

Pro vytvoření hlasového klonu AI stačí pouhý krátký vzorek hlasu – často jen minuta nebo i méně. Hlasové vzorky se často získávají z příspěvků na veřejných sociálních sítích, díky čemuž jsou obzvláště zranitelní video blogeři a influenceři, protože kvalita zvuku jejich příspěvků je vysoká a snadno dostupná.

Jakmile podvodníci získají vzorek hlasu, využijí převod textu na řeč nebo i převod řeči na řeč v reálném čase, a to k vytváření falešných telefonátů a hlasových zpráv.

Poté, co podvodník získá přístup k sociálním sítím oběti a shromáždí osobní informace, vytvoří uvěřitelný scénář. Může se jednat o hospitalizaci, zatčení, krádež, únos – cokoliv, co vyvolává strach. Následně se klonovaný hlas použije k manipulaci s rodinným příslušníkem, aby uvěřil, že se jeho blízký nachází ve vážných problémech.

Realističnost hlasu a emocí v kombinaci s šokem a naléhavostí požadavku mohou potlačit skepsi, což vede k neuváženým rozhodnutím, jako je převod peněz nebo poskytnutí citlivých údajů.

Proč jsou podvody s hlasovým klonováním pomocí AI tak účinné?

Stejně jako většina podvodů zaměřených na rodinu a přátele, i podvod s hlasovým klonováním pomocí AI je účinný, protože zneužívá osobních vazeb. Panika z přijetí tísňového volání od blízké osoby může rychle zatemnit úsudek, což vede k unáhleným rozhodnutím. Jedná se o stejnou taktiku, jaká se používá při podvodech typu quid pro quo, ale účinek se umocňuje tím, že slyšíte hlas někoho blízkého.

Příbuzní osob s velkou aktivitou na sociálních sítích nebo ti, kteří hodně cestují, jsou obzvláště ohroženi, protože tyto situace podvodníkům poskytují věrohodný kontext pro jejich vymyšlený příběh. Podvodníci často předem shromažďují a zneužívají soukromé údaje svých cílů z jejich veřejně přístupných účtů na sociálních sítích, což činí příběh ještě přesvědčivějším.

Klíčové znaky podvodu s hlasovým klonováním pomocí AI

Navzdory své sofistikovanosti se mohou podvody s hlasovými klony AI odhalit prostřednictvím určitých varovných signálů:

- Naléhavost: Podvodník se vás snaží přesvědčit, že se stane něco strašného, pokud okamžitě nebudete jednat.

- Nesrovnalosti: Podvodníci nemusí znát všechny detaily vašeho vztahu s osobou, kterou napodobují, proto věnujte pozornost jakýmkoli nesrovnalostem.

- Neobvyklé požadavky: Žádosti o převod peněz na zahraniční bankovní účty nebo platby v kryptoměně jsou běžnou taktikou.

Zvážení těchto faktorů při setkání se strašidelným scénářem je náročné, ale může vás to ochránit před podvodem.

Co dělat, pokud máte podezření na podvod s hlasovým klonováním pomocí AI

Pokud obdržíte telefonát nebo hlasovou zprávu od vašich blízkých, kteří se nacházejí v tísni, zachovejte chladnou hlavu. Podvodníci se spoléhají na vaši paniku a emoce, protože to zvyšuje vaši zranitelnost vůči jejich taktikám.

Pokud přijmete telefonát

Pokud máte i sebemenší podezření, že telefonát může být podvodným klonováním hlasu, okamžitě hovor ukončete. Nesdělujte žádné informace a neinteragujte s podvodníky. Místo toho zavolejte své blízké zpět na jejich známé číslo, abyste si ověřili pravdivost tísňového volání.

Další komunikace s podvodníky by mohla vést k nahrání a naklonování vašeho hlasu.

Pokud obdržíte hlasovou zprávu

Pokud podvodníci zanechali hlasovou zprávu, neprodleně si uložte zvuk do svého telefonu nebo notebooku. Tento zvukový vzorek lze použít v nástroji pro klasifikaci řeči AI, aby se zjistilo, zda se jedná o lidský hlas. Tyto nástroje fungují podobně jako detektory psaní textů generovaných AI. Jednoduše nahrajte zvukový soubor a klasifikátor jej označí, zda byl vytvořen člověkem, nebo umělou inteligencí.

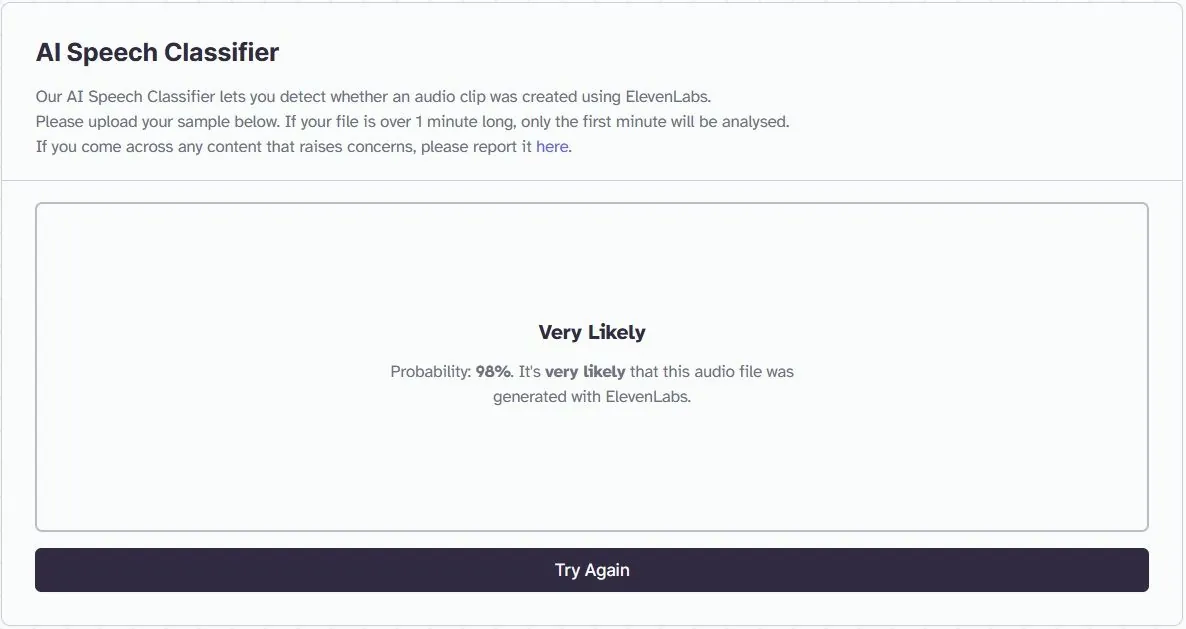

Skvělým nástrojem pro ověření je klasifikátor řeči ElevenLabs. Společnost ElevenLabs stojí za většinou platforem pro klonování AI, takže je to ideální nástroj k odhalení, zda byl hlas naklonován. Zde je postup, jak jej můžete použít ke zjištění hlasu klonovaného pomocí AI:

V následujícím příkladu člověk nahrál znepokojivou zprávu a vložil ji do klasifikátoru. Můžete vidět, že byla označena s 2% pravděpodobností manipulace.

V dalším příkladu byla stejná znepokojivá zpráva vytvořena pomocí nástroje pro klonování hlasu AI. Pro lidské ucho jsou tyto hlasy nerozeznatelné. Nicméně tento nástroj ji označil s 98% pravděpodobností, že byla vygenerována AI.

I když se na tento klasifikátor nemůžete 100% spolehnout, může vám potvrdit podezření na použití klonovaného hlasu. Pro jistotu byste měli také kontaktovat svého blízkého na známém čísle.

Prevence je nejlepší obranou proti podvodům s hlasovým klonováním pomocí AI

Někdy je nejlepší obranou proti high-tech podvodu low-tech řešení.

S rodinou a přáteli si vytvořte offline heslo, které znáte jen vy. V případě tísňového volání může být použití tohoto hesla spolehlivým způsobem, jak potvrdit totožnost volajícího.

V neposlední řadě je důležité chránit své soukromé informace mimo sociální sítě, protože je to zásadní krok k zajištění toho, aby podvodníci nemohli získat dostatek informací k vytvoření podvodného příběhu. Nezapomeňte: Pokud nechcete, aby to všichni věděli, nesdílejte to na sociálních sítích.