Pochopení Vysvětlitelné Umělé Inteligence (XAI) a Její Význam

Vysvětlitelná umělá inteligence, často označovaná zkratkou XAI, je dynamicky se rozvíjející obor. Její význam v podnikové sféře neustále stoupá, neboť XAI pomáhá firmám dešifrovat a objasňovat fungování modelů umělé inteligence a strojového učení.

V dnešním digitálně orientovaném světě jsou data klíčová a umělá inteligence se stává ústředním bodem zájmu.

Různá řešení, využívající umělou inteligenci, jsou nasazována v mnoha odvětvích s cílem urychlit růst a zefektivnit provoz.

XAI vám také pomůže proniknout do hloubky fungování modelů umělé inteligence a pochopit, jak dosahují svých výstupů.

Pokud se stále ptáte, proč byste se o XAI měli zajímat, tento článek je pro vás jako stvořený.

Pojďme se na to podívat!

Co je Vysvětlitelná Umělá Inteligence?

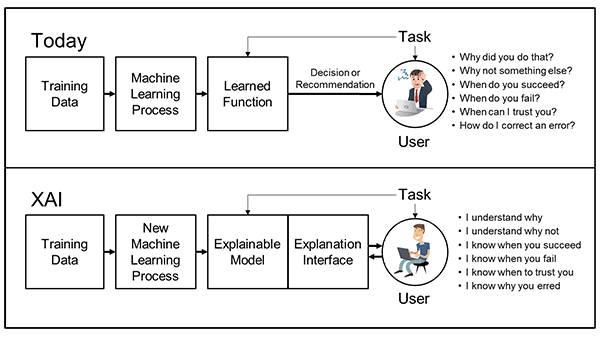

Vysvětlitelná umělá inteligence (XAI) je soubor metod a procesů zaměřených na to, aby uživatelé lépe chápali výsledky a výstupy modelů umělé inteligence a mohli jim plně důvěřovat. XAI v podstatě umožňuje uživatelům nahlédnout do mechanismů složitých algoritmů strojového učení a odhalit logiku, která stojí za rozhodováním těchto modelů.

Díky svému rámce a nástrojům XAI napomáhá vývojářům a organizacím vnést do modelů umělé inteligence prvek transparentnosti. Uživatelé tak mohou pochopit, jak dochází k predikcím. To je výhodné pro každou organizaci, která implementuje AI v různých oblastech, protože XAI zvyšuje přesnost, zlepšuje výsledky a zajišťuje průhlednost AI.

XAI také pomáhá odhalovat případné zkreslení a problémy, které mohou složité algoritmy strojového učení přinášet při práci na konkrétních výstupech. Modely, které se chovají jako „černá skříňka“ a vznikají jako výsledek komplexních algoritmů, je téměř nemožné pochopit, dokonce i pro datové vědce, kteří je vytvářejí.

Transparentnost, kterou XAI přináší, je pro organizace velkým přínosem. Pomáhá jim efektivně využívat potenciál AI a činit správná rozhodnutí. Vysvětlení, která XAI nabízí, jsou nejčastěji ve formě textů nebo vizualizací, které umožňují proniknout do vnitřního fungování modelů umělé inteligence.

Pro objasnění dalších metadatových informací o modelu AI využívá XAI i další mechanismy vysvětlování – relevanci funkcí, zjednodušená vysvětlení a vysvětlení pomocí příkladů.

Poptávka po XAI rychle roste, protože stále více organizací ji zavádí do svých systémů. S tím, jak se XAI vyvíjí, zlepšují se i techniky a procesy vysvětlování.

Proč je XAI tak Důležitá?

V současné době se většina organizací spoléhá na modely umělé inteligence pro řízení svých obchodních operací a rozhodování o budoucích krocích na základě predikcí AI. Tyto předpovědi však nejsou vždy zcela přesné a často se potýkají s různými zkresleními, což je běžný problém u většiny modelů AI.

Zkreslení vycházejí z různých faktorů a ovlivňují rozhodování modelů umělé inteligence. Je typické, že kvalita rozhodnutí umělé inteligence se často zhoršuje, když je model napájen daty z provozu, která se liší od trénovacích dat.

Kromě toho může být vysvětlování modelů strojového učení a neuronových sítí obtížné a pro datové vědce je často nemožné je interpretovat. Pokud plně důvěřujete každému rozhodnutí modelů AI pro růst vaší společnosti, může to vést k nepředvídatelným problémům a brzdit celkový rozvoj.

Proto je pro organizace klíčové, aby dokonale rozuměly rozhodovacím procesům a logice AI, které stojí za každým výstupem, jenž tyto modely poskytují. Zde se XAI stává praktickým nástrojem, který organizacím pomáhá získat úplné vysvětlení rozhodovacího procesu daného modelu AI, včetně veškeré použité logiky.

Od pochopení algoritmů strojového učení až po vyhodnocování neuronových sítí a sítí hlubokého učení vám XAI pomůže monitorovat vše a získat přesná vysvětlení pro každé rozhodnutí. S implementací XAI bude snazší posoudit přesnost a odpovědnost každého rozhodnutí AI a rozhodnout, zda je vhodné pro vaši organizaci.

XAI navíc hraje zásadní roli při zavádění a udržování odpovědného modelu umělé inteligence v podnikovém ekosystému. Zajišťuje spravedlivá a přesná rozhodnutí. XAI také pomáhá udržovat důvěru mezi koncovými uživateli a omezuje rizika spojená s bezpečností a dodržováním předpisů.

Jak XAI Funguje?

Moderní technologie AI, které se implementují v podnicích, generují výstupy nebo rozhodnutí pomocí různých modelů. Tyto technologie umělé inteligence však neuvádí, jak k danému výsledku dospěly, ani logiku, která za rozhodnutím stojí.

Aby podniky překlenuly tuto mezeru, nyní implementují XAI, která používá vysvětlitelný model a veškeré informace o metadatech s rozhraním vysvětlení. To pomáhá pochopit, jak model AI pracuje.

Při zavádění technologie AI do obchodního ekosystému se metody AI implementují na různých úrovních. Těmito metodami umělé inteligence jsou strojové učení (ML), strojové uvažování (MR) a integrace mezi MR a ML.

Komponenty, které XAI zavádí do existujícího modelu AI, jsou konkrétně vysvětlení, vysvětlitelnost dat, vysvětlitelnost MR a vysvětlitelnost ML. Navíc XAI zavádí interpretovatelnost a vysvětlitelnost mezi MR a ML.

Fungování XAI lze rozdělit do tří oblastí:

- Vysvětlitelná data: Zvýrazňuje typ dat a jejich obsah, který se používá k trénování modelu AI. Ukazuje důvod volby, proces výběru a odhad úsilí potřebného k odstranění zkreslení.

- Vysvětlitelné predikce: XAI představuje všechny funkce, které model AI použil pro získání výstupu.

- Vysvětlitelné algoritmy: Odhaluje všechny vrstvy v modelu AI a objasňuje, jak každá vrstva přispívá k vytvoření konečného výstupu.

Vysvětlitelné predikce a algoritmy jsou však stále ve fázi vývoje. Pro vysvětlení neuronových sítí lze zatím použít pouze vysvětlitelná data.

Pro vysvětlení rozhodovacích procesů využívá XAI dva hlavní přístupy:

- Proxy modelování: Používá se přibližný model, který se liší od původního. Výsledkem je přibližný výstup, který se může lišit od skutečného výsledku.

- Návrh pro Interpretovatelnost: Populární přístup, kde XAI vyvíjí model, který je srozumitelný pro uživatele. Tyto modely však mohou postrádat přesnost nebo výkon ve srovnání se skutečnými modely AI.

Výhody XAI

Vysvětlitelná umělá inteligence, XAI, má velký vliv na rozvoj umělé inteligence, neboť pomáhá lidem pochopit, jak AI funguje. Nabízí mnoho výhod, jako například:

Zlepšuje Transparentnost a Důvěru

Podniky, které implementují modely umělé inteligence, mohou lépe chápat, jak komplexní modely AI fungují a proč generují specifické výstupy za různých okolností.

XAI je také velmi užitečná pro pochopení logiky fungování modelů typu „černá skříňka“. Zlepšuje se tak transparentnost a buduje důvěra mezi strojovými a lidskými uživateli.

Podporuje Širší Přijetí Modelů Umělé Inteligence

S tím, jak organizace začínají chápat pracovní a logické procesy, které se skrývají za modely AI, a uvědomují si jejich výhody, roste míra přijetí modelů AI. Díky srozumitelným vysvětlením je snazší důvěřovat rozhodnutím, které AI generuje.

Zvyšuje Produktivitu

Díky implementaci XAI v systémech AI mohou operační týmy ML snadno identifikovat chyby a oblasti, které vyžadují zlepšení. XAI také pomáhá udržovat hladký a efektivní provoz procesů umělé inteligence.

Výsledkem je výrazné zvýšení produktivity, protože tým MLOps může pochopit logiku, která vede model AI k vytvoření daného výstupu.

Snižuje Rizika a Náklady

XAI pomáhá snižovat náklady spojené s řízením modelů AI. Protože objasňuje všechny výsledky a potenciální rizikové oblasti, snižuje se potřeba ruční kontroly a minimalizují se nákladné chyby, které by mohly narušit vztahy s koncovými uživateli.

Objevuje Nové Příležitosti

Pokud váš technický a obchodní tým získají náhled na rozhodovací procesy AI, mají šanci objevit nové příležitosti. Hlubší analýza konkrétních výsledků může odhalit nové souvislosti, které původně nebyly zřejmé.

Výzvy XAI

Mezi běžné výzvy spojené s XAI patří:

- Obtíže s interpretací: Některé systémy ML je obtížné interpretovat. Vysvětlení, která XAI poskytuje, jsou pak pro uživatele těžko srozumitelná. Pokud je strategie „černé skříňky“ nevysvětlitelná, může způsobit vážné provozní a etické problémy.

- Spravedlnost: Pro XAI je náročné určit, zda je konkrétní rozhodnutí AI spravedlivé či nikoli. Spravedlnost je subjektivní a závisí na datech, na kterých byl model AI trénován.

- Zabezpečení: Uživatelé mohou provádět akce, aby změnili rozhodovací proces modelu ML a ovlivnili výstup ve svůj prospěch. Technický personál může pouze obnovit datovou sadu, kterou algoritmus použil pro trénink.

Rozdíl mezi XAI a AI

Ačkoli XAI a AI spolu souvisejí, existují mezi nimi zásadní rozdíly.

| Vysvětlitelná AI (XAI) | Umělá Inteligence (AI) |

| Poskytuje vysvětlení nebo logiku rozhodovacího procesu komplexního modelu ML. | Poskytuje pouze verdikt nebo výstup rozhodnutí provedeného modelem ML. |

| Díky správnému vysvětlení pomáhá uživatelům více důvěřovat modelu umělé inteligence. | Uživatelé se při pouhém verdiktu mohou cítit zmatení, jak AI dospěla k závěru, a proto je vyžadována větší míra důvěry. |

| Snižuje zkreslení, které je spojené s mnoha modely umělé inteligence. | Často se rozhoduje na základě zkreslení, která jsou běžná ve skutečném světě. |

| Snižuje náklady spojené s chybami v systémech AI. Modely AI nejsou stoprocentně přesné a mohou vytvářet špatné predikce. | Pokud model AI udělá nesprávnou predikci, může to vést k finančním ztrátám. |

| XAI se stále vyvíjí a má omezení, zejména pokud jde o vysvětlování komplexních modelů typu „černá skříňka“. | AI jako celek se již značně vyvinula a dokáže efektivně řešit mnoho problémů bez obtíží. |

| Vzhledem k tomu, že XAI vysvětluje logiku a rozhodovací proces modelu, může ho někdo snadno ovlivnit. | Modely AI neposkytují důvod nebo logiku, která stojí za jejich predikcí, takže je těžší je ovlivnit. |

Dopad XAI na Různé Sektory

Příchod XAI měl významný dopad na různá odvětví, kde umělá inteligence hraje klíčovou roli při rozhodování. Pojďme se na to podívat blíže.

#1. Finance

Řešení založená na AI se ve finančním sektoru používají ve velké míře a většina společností je využívá pro různé úkoly. Finanční sektor je však silně regulován a vyžaduje mnoho auditů před tím, než jsou finanční rozhodnutí přijata.

XAI zde může pomoci tím, že předloží odůvodnění finančních rozhodnutí. Je to důležitý nástroj pro budování důvěry koncových uživatelů, kteří tak pochopí důvody pro finanční rozhodnutí organizací.

#2. Zdravotní Péče

Zavádění XAI přineslo zdravotnickým systémům mnoho výhod. Může pomoci odhalovat a diagnostikovat různá onemocnění a odstraňovat jejich hlavní příčiny. To umožňuje lékařům poskytovat správnou léčbu.

#3. Výroba

V současnosti se modely umělé inteligence intenzivně využívají ve výrobních odvětvích pro aplikace v oblasti správy, údržby, logistiky atd. Tyto modely však nejsou vždy konzistentní, což vede k problémům s důvěrou.

XAI pomáhá řešit mnoho takových problémů, protože dokáže objasnit, proč je pro různé výrobní aplikace zvolen určitý postup. Umožňuje pracovníkům pochopit logiku a důvod konkrétních rozhodnutí, což pomáhá budovat důvěru.

#4. Automobilový Průmysl

Integrace XAI do samořídících vozidel byla nezbytná, protože umožňuje vozidlu poskytnout vysvětlení pro každé rozhodnutí, které učiní v případě nehody. Učením se z různých situací a nehod pomáhá XAI autonomním vozům lépe se rozhodovat a zvyšovat celkovou bezpečnost cestujících i chodců.

Výukové Zdroje

Kromě informací uvedených výše můžete zvážit i několik knih a kurzů, pokud se chcete o XAI dozvědět více.

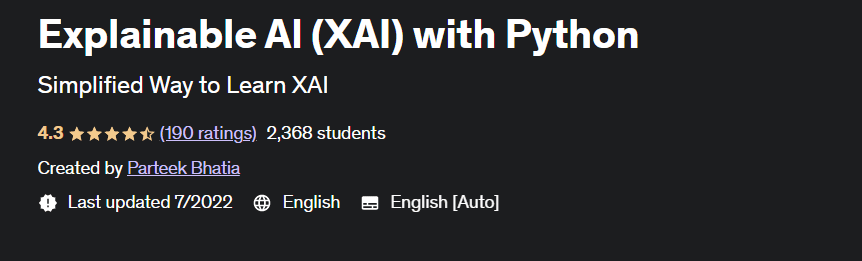

#1. Vysvětlitelná Umělá Inteligence s Pythonem

Kurz Vysvětlitelná AI s Pythonem na platformě Udemy navrhl Parteek Bhatia. Pomůže vám prozkoumat různé aspekty XAI, včetně aplikací, technik XAI a nástrojů What-if od společnosti Google. Kurz také zahrnuje kategorizaci XAI z různých pohledů.

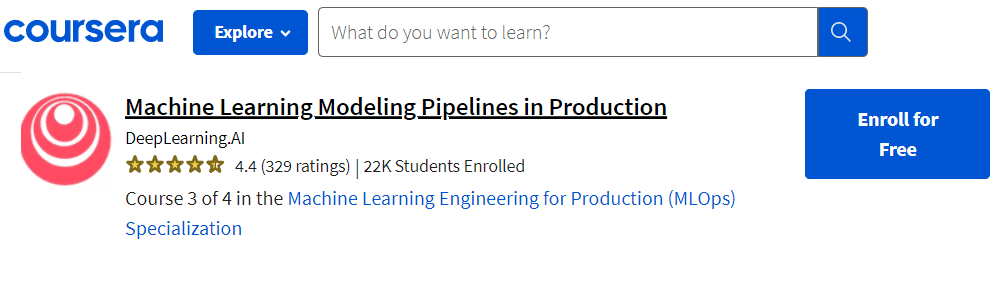

#2. Strojové Učení – Modelování Potrubí

Pokud se chcete naučit vysvětlitelnou AI a získat znalosti o implementaci nástrojů a technik pro správu modelů, pak je kurz Machine Learning Modeling Pipeline na Coursera to pravé pro vás.

Patří mezi nejlépe hodnocené kurzy, má mnoho pozitivních recenzí a učí ho renomovaný lektor Robert Crowe. Nabízí dlouhodobé studium modelové analýzy a interpretovatelnosti.

#3. Vysvětlitelná Umělá Inteligence

Kniha „Explainable Artificial Intelligence“, kterou společně napsali Uday Kamath a John Liu, je výborným zdrojem pro studium interpretovatelnosti ve strojovém učení.

Najdete zde mnoho případových studií a souvisejících materiálů pro výuku XAI. Autoři knihy poskytli mnoho praktických příkladů, které usnadňují pochopení XAI.

#4. Praktická Vysvětlitelná Umělá Inteligence (XAI) s Pythonem

Hand-on Explainable AI (XAI) s Pythonem je oblíbená kniha od Denise Rothmana.

Nabízí detailní studii nástrojů a technik XAI pro pochopení výstupů AI, které jsou potřebné v moderním podnikání. Naučíte se také, jak zvládat a předcházet různým problémům spojeným se zkreslením v AI.

Závěr

Vysvětlitelná umělá inteligence je efektivní koncept, který usnadňuje majitelům firem, datovým analytikům a inženýrům porozumět rozhodovacím procesům modelů umělé inteligence. XAI dokáže interpretovat i složité modely ML, které je pro datové vědce dokonce nemožné dešifrovat.

Přestože se XAI postupem času vyvíjí, stále existují oblasti, které je nutné zlepšit. Doufáme, že vám tento článek pomohl lépe pochopit XAI, její fungování, výhody, výzvy a aplikace v různých odvětvích. Doporučujeme vám také prozkoumat uvedené kurzy a knihy, abyste získali další informace o XAI.

Doporučujeme si také přečíst o Úzké Umělé Inteligenci (ANI).